发布千卡规模异构芯片混训平台,无问芯穹要打造最具性价比的基础建设

基础设施,在AI时代里是什么样一个角色?有人说像电,发布千卡规模异构芯片混训平台,无问芯穹要打造最具性价比的基础建设有人说像水。

无问芯穹认为,优良的基础建设,是一种「魔法」,能够让大模型成本有效下降,让更多人拥抱新技术。

7月4日,无问芯穹联合创始人兼CEO夏立雪发布了全球首个千卡规模异构芯片混训平台,千卡异构混合训练集群算力利用率最高达到了97.6%。

四个月前,无问芯穹Infini-AI大模型开发与服务云平台宣布首次公测,已有智谱AI、月之暗面、生数科技等大模型公司客户在Infini-AI上稳定使用异构算力,还有20余家AINative应用创业公司在Infini-AI上持续调用各种预置模型API,使用无问芯穹提供的工具链开发自身业务模型。

建设大模型时代的AINative基础设施,不仅能够为AI开发者提供更加通用、高效、便捷的研发环境,同时也是实现算力资源有效整合,支撑AI产业可持续发展的关键基石。与国际上模型层与芯片层「相对集中」的格局相比,中国的模型层与芯片层更加有多样性。

然而,多样性也意味着挑战,大量的异构芯片也形成了「生态竖井」,不同硬件生态系统封闭且互不兼容,给算力的使用方带来一系列技术挑战。这是构建AINative基础设施的最大难点,也是当前大模型行业面临「算力荒」的重要原因。

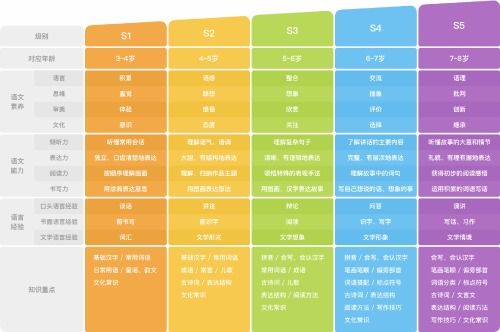

无问芯穹具备顶尖的AI计算优化能力与算力解决方案能力,以及对「M种模型」与「N种芯片」行业格局的前瞻判断,率先构建了「MxN」中间层的生态格局,实现多种大模型算法在多元芯片上的高效、统一部署。

截至目前,Infini-AI已支持了Qwen2、GLM4、Llama3、Gemma、Yi、Baichuan2、ChatGLM3系列等共30多个模型,以及AMD、华为昇腾、壁仞、寒武纪、燧原、海光、天数智芯、沐曦、摩尔线程、NVIDIA等10余种计算卡。

「技术上限推高与技术落地扩散不矛盾,且取决于我们决心如何对待这个技术。」夏立雪表示,「未来我们用各种AI应用时,也不会知道它调用了哪些基座模型,用到了哪种加速卡的算力——这就是最好的AINative基础设施。」

版权声明

本文仅代表作者观点,不代表百度立场。

本文系作者授权百度百家发表,未经许可,不得转载。